L’IA peut-elle vraiment comprendre nos émotions ?

Dans cette page :

- Pourquoi le visage ne suffit pas

- Le contexte : une fausse bonne idée ?

- Une idée clé : séparer pour mieux comprendre

Comment savoir si une personne âgée souffre en silence ? Comment détecter le stress ou l’anxiété d’un patient atteint de la maladie d’Alzheimer, lorsqu’il ne parvient plus à exprimer clairement son ressenti ? Pour de nombreuses personnes, notamment les seniors ou celles atteintes de troubles neurodégénératifs, les émotions constituent un indicateur de bien-être essentiel, mais souvent difficile à percevoir.

C’est précisément sur cette problématique que travaillent les chercheurs de l’unité de recherche CESI LINEACT. À travers leurs travaux en intelligence artificielle et en vision par ordinateur, ils explorent comment l’IA peut devenir un outil d’aide plus fin, plus nuancé et plus respectueux de la réalité humaine. Un travail de recherche récent présenté lors de la conférence internationale ICIAP 2025 mené par Amine Bohi et Varsha Devi, propose une approche innovante pour dépasser les limites actuelles de la reconnaissance automatique des émotions.

Pourquoi le visage ne suffit pas

« On a souvent l’impression que reconnaître une émotion, c’est juste reconnaître une expression du visage. En réalité, c’est beaucoup plus complexe que ça », explique Varsha Devi, chercheuse en vision par ordinateur à CESI LINEACT.

L’analyse faciale seule est insuffisante pour trois raisons majeures :

- Le visage est un indice, pas une preuve : Une expression peut être trompeuse. Nous sourions par politesse, nous masquons notre inquiétude… Le visage seul ne raconte pas toute l’histoire et peut mener à des contresens.

- Le cas des « visages neutres » : Le problème est particulièrement aigu chez les personnes atteintes de troubles cognitifs. Leurs expressions sont souvent peu marquées, neutres, ou affichent des émotions négatives dominantes (tristesse, anxiété) qui peuvent masquer leur véritable état intérieur.

- Le risque d’interprétations erronées : En se basant uniquement sur ces signaux ambigus, les modèles d’IA classiques aboutissent souvent à des classifications réductrices ou tout simplement fausses. Ce constat, déjà bien documenté en neuropsychiatrie et en neurologie, impose de chercher des indices au-delà du visage.

Le visage donne des indices, mais ce n’est jamais une preuve absolue. Si on s’arrête là, on prend le risque de se tromper

Résume Amine Bohi, enseignant-chercheur à CESI LINEACT.

Le contexte : une fausse bonne idée ?

Pour améliorer la reconnaissance des émotions, une idée s’est alors imposée : ajouter le contexte. Après tout, une émotion n’existe jamais hors sol. Elle dépend d’un lieu, d’une situation, d’un environnement. Mais là encore, les chercheurs ont identifié un piège.

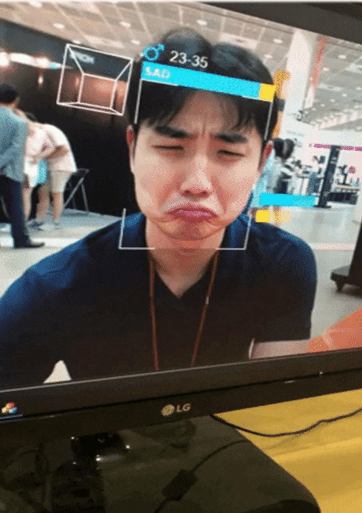

Prenons un exemple simple. Une personne au visage neutre, photographiée dans un hôpital, sera très souvent interprétée comme triste par un modèle d’IA. La même personne, avec exactement la même expression, dans un parc ou lors d’un événement festif, pourra être jugée sereine ou heureuse. Dans ce cas, l’IA ne lit plus l’émotion de la personne : elle lit le décor.

« Le risque est que l’algorithme apprenne principalement des raccourcis : hôpital = tristesse, fête = joie. Cela projette alors des stéréotypes sur les individus », comme le soulignent les recherches menées par Amine Bohi et Varsha Devi.

Ce phénomène est appelé le biais de contexte. Il se manifeste lorsque l’IA accorde plus d’importance à l’environnement qu’à l’individu lui-même.

La conséquence est grave : le modèle n’apprend pas à lire l’émotion réelle de l’individu. Il apprend à créer des « raccourcis statistiques » en associant un lieu (l’hôpital) à une émotion stéréotypée (la tristesse). Au lieu d’aider, la technologie se met à projeter des préjugés sur la personne. De ce constat découle la problématique centrale de ce projet de recherche :

Comment intégrer le contexte sans qu’il prenne le pas sur l’individu ?

Une idée clé : séparer pour mieux comprendre

La réponse proposée par les chercheurs de CESI LINEACT repose sur une idée à la fois simple et ingénieuse : séparer pour mieux comprendre. Leur modèle analyse le visage et le contexte… mais pas ensemble tout de suite.

D’un côté, le visage est étudié comme la source principale d’information sur l’individu. De l’autre, le contexte est analysé séparément, en masquant volontairement le visage. Cela force l’IA à regarder uniquement l’environnement, sans pouvoir s’appuyer sur l’expression faciale.

C’est ici qu’intervient le mécanisme clé : le « débruitage » du contexte. Dans ce projet, ce terme ne désigne pas la suppression d’un bruit sonore, mais la suppression des biais contextuels. Ce mécanisme a été spécifiquement conçu pour forcer le modèle à abandonner les « raccourcis statistiques » en l’empêchant d’associer aveuglément un lieu à une émotion. Pour y parvenir, le modèle soumet l’information contextuelle à un processus complexe où elle est d’abord transformée, voire « bruitée », avant que son influence ne soit corrigée et partiellement soustraite. Il utilise les signaux issus du visage comme un « guide » : si le visage exprime une émotion qui contredit fortement le stéréotype associé à la scène, l’algorithme apprend à faire davantage confiance à l’individu qu’à l’environnement.

On apprend à l’IA à se poser une question simple : est-ce que le décor est vraiment en train de m’expliquer l’émotion, ou est-ce qu’il me trompe ?

Enfin, les informations issues du visage et celles du contexte (« débruitées » et corrigées) sont fusionnées. Ce processus permet de produire une reconnaissance émotionnelle plus équilibrée, réaliste et juste, capable de s’adapter à une grande variété de situations réelles. Cette avancée méthodologique est une brique fondamentale qui prépare le terrain pour des applications concrètes et plus robustes.

À ce stade, il s’agit encore de recherche fondamentale, menée au sein de l’unité de recherche CESI LINEACT. L’objectif n’est pas de proposer immédiatement un outil médical, mais de poser des bases solides, scientifiquement fiables, pour de futures applications.

Ces travaux ouvrent toutefois des perspectives importantes, notamment dans le domaine de la santé et de l’accompagnement des personnes vulnérables. Mieux détecter le stress, l’inconfort ou la souffrance émotionnelle pourrait, demain, aider les professionnels à intervenir plus tôt et de manière plus adaptée.

En apprenant à l’IA à ne pas se laisser piéger par les apparences, les chercheurs de CESI nous rappellent une chose essentielle : comprendre les émotions humaines demande de la nuance, du contexte… et surtout beaucoup d’humilité. Une leçon précieuse, pour l’intelligence artificielle comme pour nous.